什么是朴素贝叶斯?

朴素贝叶斯是一种简单但令人惊讶的强大的预测建模算法。

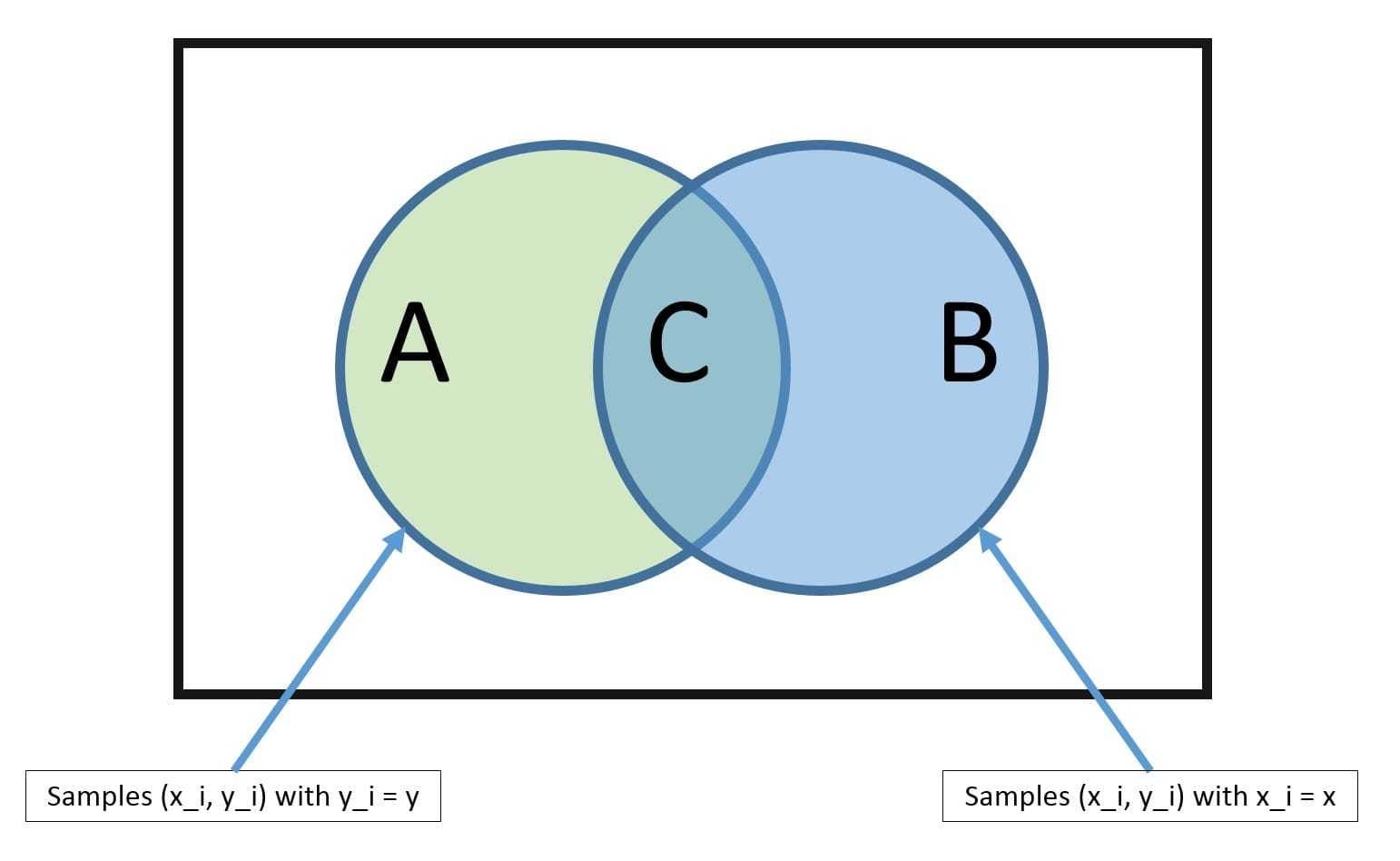

该模型由两种类型的概率组成,可以直接根据您的训练数据计算:

- 每个班级的概率

- 给出每个x值的每个类的条件概率。

一旦计算,概率模型可用于使用贝叶斯定理对新数据进行预测。当您的数据是实值时,通常假设高斯分布(钟形曲线),以便您可以轻松估计这些概率。

朴素贝叶斯被称为朴素,因为它假设每个输入变量是独立的。这是一个强有力的假设,对于实际数据是不现实的,然而,该技术对于大范围的复杂问题非常有效。

朴素贝叶斯的优缺点

优点:

- 朴素贝叶斯模型发源于古典数学理论,有着坚实的数学基础,以及稳定的分类效率。

- 对大数量训练和查询时具有较高的速度。即使使用超大规模的训练集,针对每个项目通常也只会有相对较少的特征数,并且对项目的训练和分类也仅仅是特征概率的数学运算而已;

- 对小规模的数据表现很好,能个处理多分类任务,适合增量式训练(即可以实时的对新增的样本进行训练);

- 对缺失数据不太敏感,算法也比较简单,常用于文本分类;

- 朴素贝叶斯对结果解释容易理解。

缺点:

- 需要计算先验概率;

- 分类决策存在错误率;

- 对输入数据的表达形式很敏感;

- 由于使用了样本属性独立性的假设,所以如果样本属性有关联时其效果不好。

百度百科版本

朴素贝叶斯法是基于贝叶斯定理与特征条件独立假设的分类方法 。最为广泛的两种分类模型是决策树模型(Decision Tree Model)和朴素贝叶斯模型(Naive Bayesian Model,NBM)。

和决策树模型相比,朴素贝叶斯分类器(Naive Bayes Classifier,或 NBC)发源于古典数学理论,有着坚实的数学基础,以及稳定的分类效率。同时,NBC模型所需估计的参数很少,对缺失数据不太敏感,算法也比较简单。理论上,NBC模型与其他分类方法相比具有最小的误差率。但是实际上并非总是如此,这是因为NBC模型假设属性之间相互独立,这个假设在实际应用中往往是不成立的,这给NBC模型的正确分类带来了一定影响。

维基百科版本

在机器学习中,朴素贝叶斯分类器是一系列简单的“ 概率分类器 ”,它基于贝叶斯定理应用特征之间的强(天真)独立假设。

自20世纪50年代以来,朴素贝叶斯就被广泛研究过。它在20世纪60年代早期以不同的名称引入文本检索社区,并且仍然是文本分类的流行(基线)方法,即将文档判断为属于一个类别或另一个类别的问题(例如垃圾邮件或合法,体育或政治等)以词频为特征。通过适当的预处理,它在这个领域具有更高级的方法,包括支持向量机,具有竞争力。它也适用于自动医疗诊断。

朴素贝叶斯分类器具有高度可扩展性,在学习问题中需要多个变量(特征/预测器)数量的线性参数。最大似然的训练可以通过评估来完成闭合形式的表达,这需要线性时间,而不是由昂贵的迭代逼近作为用于许多其它类型的分类器。

在统计学和计算机科学文献中,朴素的贝叶斯模型以各种名称而闻名,包括简单的贝叶斯和独立贝叶斯。所有这些名称都引用了贝叶斯定理在分类器决策规则中的使用,但朴素贝叶斯(必然)不是贝叶斯方法。

1 Comment

介绍的太简单了一些