什麼是 GPU?

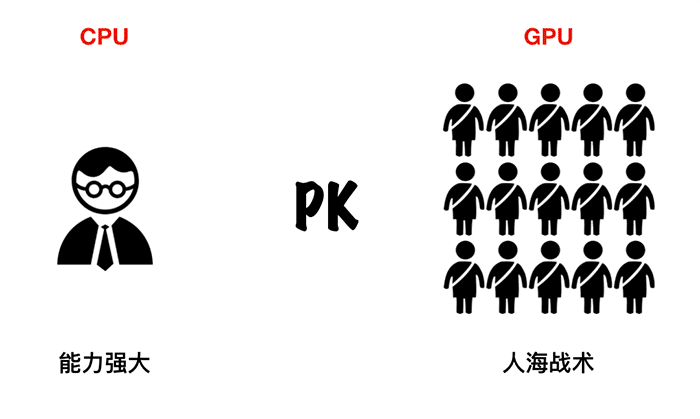

CPU 能力更強大,能做很多事情,適合處理複雜的任務。GPU 結構簡單,可以形成人海戰術,適合處理重複簡單的任務。

知乎上有一個回答很應景:

一個數學教授和100個小學生PK。

第一回合,四則運算,一百個題。教授拿到卷子一道道算。一百個小學生各拿一道題。教授剛開始算到第二題的時候,小學生集體交卷。第一回合小學生碾壓教授。

第二回合,高等函數。一百個題。當教授搞定後。一百個小學生還不知道在幹嘛…….第二回合,教授碾壓一百個小學生。好理解嗎?

這就是CPU和GPU的淺顯比較。

百度百科版本

圖形處理器(英語:Graphics Processing Unit,縮寫:GPU),又稱顯示核心、視覺處理器、顯示芯片,是一種專門在個人電腦、工作站、遊戲機和一些移動設備(如平板電腦、智能手機等)上圖像運算工作的微處理器。

用途是將計算機系統所需要的顯示信息進行轉換驅動,並向顯示器提供行掃描信號,控制顯示器的正確顯示,是連接顯示器和個人電腦主板的重要元件,也是「人機對話」的重要設備之一。顯卡作為電腦主機里的一個重要組成部分,承擔輸出顯示圖形的任務,對於從事專業圖形設計的人來說顯卡非常重要。

維基百科版本

圖形處理單元(GPU)是一個專門的電子電路設計成迅速操縱和改變存儲器加速的創建圖像在一個幀緩衝器旨在用於輸出到顯示裝置。GPU用於嵌入式系統,流動電話,個人計算機,工作站和遊戲控制台。現代GPU在處理計算機圖形和圖像處理方面非常有效。它們高度並行的結構使它們比通用的更有效用於並行處理大塊數據的算法的CPU。在個人計算機中,GPU可以存在於視頻卡上或嵌入在主板上。在某些CPU中,它們嵌入在CPU 芯片上。

GPU至少在20世紀80年代一直被使用,它在1999年由Nvidia推廣,他將GeForce 256作為「世界上第一個GPU」 推向市場。它被呈現為「具有集成變換,光照,三角形設置/剪切和渲染引擎的單芯片處理器」。競爭對手ATI Technologies在2002年發佈了Radeon 9700,創造了「 視覺處理單元 」或VPU這一術語。