CNN非常擅長對亂序圖像進行分類,但人類並非如此。

在這篇文章中,作者展示了為什麼最先進的深度神經網絡仍能很好地識別亂碼圖像,探究其中原因有助於揭示DNN使用讓人意想不到的簡單策略,對自然圖像進行分類。

在ICLR 2019一篇論文指出上述發現能夠:

- 解決ImageNet比許多人想象的要簡單得多

- 使我們能夠構建更具解釋性和透明度的圖像分類pipeline

- 解釋了現代CNN中觀察到的一些現象,例如對紋理的偏見以及忽略了對象部分的空間排序

復古bag-of-features模型

在深度學習出現之前,自然圖像中的對象識別過程相當粗暴簡單:定義一組關鍵視覺特徵(“單詞”),識別每個視覺特徵在圖像中的存在頻率(“包”),然後根據這些數字對圖像進行分類。 這些模型被稱為“特徵包”模型(BoF模型)。

舉個例子,給定一個人眼和一個羽毛,我們想把圖像分類為“人”和“鳥”兩類。最簡單的BoF模型工作流程是這樣的:對於圖像中的每隻眼睛,它將“人類”的證據增加+1。反之亦然;對於圖像中的每個羽毛,它將增加“鳥”的證據+1;無論什麼類積累,圖像中的大多數證據都是預測的。

這個最簡單的BoF模型有一個很好的特性,是它的可解釋性和透明的決策制定。我們可以準確地檢查哪個圖像特徵攜帶了給定的類的證據,證據的空間整合是非常簡單的(與深度神經網絡中的深度非線性特徵整合相比),很容易理解模型如何做出決定。

傳統的BoF模型在深度學習開始之前一直非常先進、非常流行。但由於其分類性能過低,而很快失寵。可是,我們怎麼確定深度神經網絡有沒有使用與BoF模型截然不同的決策策略呢?

一個很深卻可解釋的BoF網絡(BagNet)

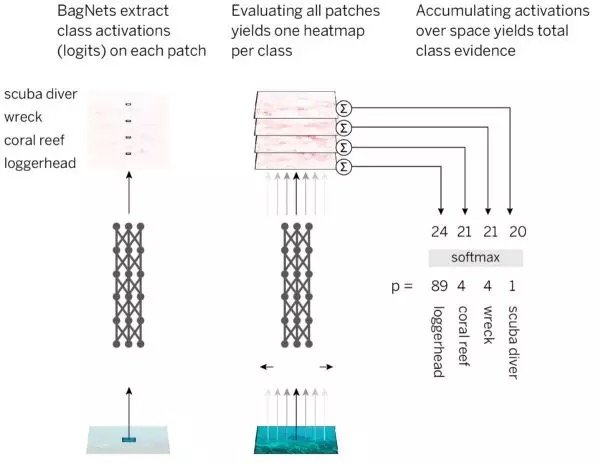

為了測試這一點,研究人員將BoF模型的可解釋性和透明度與DNN的性能結合起來。

- 將圖像分割成小的q x q圖像色塊

- 通過DNN傳遞補丁以獲取每個補丁的類證據(logits)

- 對所有補丁的證據求和,以達到圖像級決策

為了以最簡單和最有效的方式實現這一策略,我們採用標準的ResNet-50架構,用1×1卷積替換大多數(但不是全部)3×3卷積。

在這種情況下,最後一個卷積層中的隱藏單元每個只“看到”圖像的一小部分(即它們的感受野遠小於圖像的大小)。

這就避免了對圖像的顯式分區,並且儘可能接近標準CNN,同時仍然實現概述的策略,我們稱之為模型結構BagNet-q:其中q代表最頂層的感受域大小(我們測試q=9,17和33)。BagNet-q的運行時間大約是ResNet-50的運行時間的2.5倍。

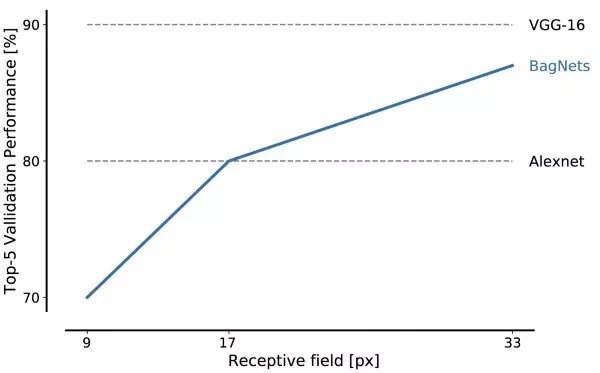

即使對於非常小的貼片尺寸,BagNet上的BagNets性能也令人印象深刻:尺寸為17 x 17像素的圖像特徵足以達到AlexNet級別的性能,而尺寸為33 x 33像素的特徵足以達到約87%的前5精度。通過更仔細地放置3 x 3卷積和額外的超參數調整,可以實現更高的性能值。

這是我們得到的第一個重要結果:只需使用一組小圖的特性即可解決ImageNet問題。對象形狀或對象部分之間的關係等遠程空間關係可以完全忽略,並且不需要解決任務。

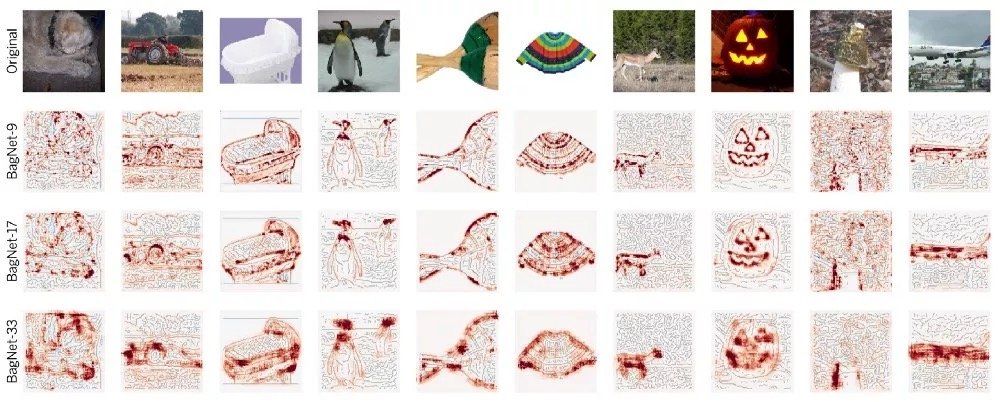

BagNets的一大特色是他們透明的決策。例如,我們現在可以查看哪個圖像特徵對於給定的類最具預測性。

上圖中,最上面的手指圖像被識別成tench(丁鱥guì,是淡水釣魚的主要魚種,也是鱸魚等獵食性魚類的飼料),因為這個類別中的大多數圖像,都有一個漁民像舉獎盃一樣舉起丁鱥。

同樣,我們還得到一個精確定義的熱圖,顯示圖像的哪些部分促使神經網絡做出某個決定。

ResNet-50與BagNets驚人相似

BagNets表明,基於本地圖像特徵和對象類別之間的弱統計相關性,可以在ImageNet上達到高精度。

如果這就夠了,為什麼像ResNet-50這樣的標準深網會學到任何根本不同的東西? 如果豐富的本地圖像特徵足以解決任務,那為什麼ResNet-50還需要了解複雜的大尺度關係(如對象的形狀)?

為了驗證現代DNN遵循與簡單的特徵包網絡類似的策略的假設,我們在BagNets的以下“簽名”上測試不同的ResNets,DenseNets和VGG:

- 決策對圖像特徵的空間改組是不變的(只能在VGG模型上測試)

- 不同圖像部分的修改應該是獨立的(就其對總類證據的影響而言)

- 標準CNN和BagNets產生的錯誤應該類似

- 標準CNN和BagNets應對類似功能敏感

在所有四個實驗中,我們發現CNN和BagNets之間的行為非常相似。 例如,在上一個實驗中,我們展示了BagNets最敏感的那些圖像部分(例如,如果你遮擋那些部分)與CNN最敏感的那些基本相同。

實際上,BagNets的熱圖(靈敏度的空間圖)比由DeepLift(直接為DenseNet-169計算熱圖)等歸因方法生成的熱圖,更好地預測了DenseNet-169的靈敏度。

當然,DNN並不完全類似於特徵包模型,但確實顯示出一些偏差。特別是,我們發現網絡越深入,功能越來越大,遠程依賴性也越來越大。

因此,更深層的神經網絡確實改進了更簡單的特徵包模型,但我認為核心分類策略並沒有真正改變。

解釋CNN幾個奇怪的現象

將CNN的決策視為一種BoF策略,可以解釋有關CNN的幾個奇怪的觀察。首先,它將解釋為什麼CNN具有如此強烈的紋理偏差;其次,它可以解釋為什麼CNN對圖像部分的混亂如此不敏感;甚至可以解釋一般的對抗性貼紙和對抗性擾動的存在,比如人們在圖像中的任何地方放置誤導信號,並且無論這些信號是否適合圖像的其餘部分,CNN仍然可以可靠地接收信號。

我們的成果顯示,CNN利用自然圖像中存在的許多弱統計規律進行分類,並且不會像人類一樣跳向圖像部分的對象級整合。其他任務和感官方式也是如此。

我們必須認真思考如何構建架構、任務和學習方法,以抵消這種弱統計相關性的趨勢。一種方式,是將CNN的歸納偏差從小的局部特徵改善為更全局的特徵;另一種方式,是刪除、或替換網絡不應該依賴的那些特徵。

然而,最大的問題之一當然是圖像分類本身的任務:如果局部圖像特徵足以解決任務,也就不需要去學習自然界的真實“物理學”,這樣我們就必須重構任務,推着模型去學習對象的物理本質。

這樣就很可能需要跳出純粹只通過觀察學習,獲得輸入和輸出特徵之間相關性的方式,以便允許模型提取因果依賴性。

總結

總之,我們的結果表明CNN可能遵循極其簡單的分類策略。科學家認為這個發現可能在2019繼續成為關注的焦點,凸顯了我們對深度神經網絡的內部運作了解甚少。

缺乏理解使我們無法從根本上發展出更好的模型和架構,來縮小人與機器之間的差距。深化我們的理解,將使我們能夠找到彌合這一差距的方法。

這將帶來異常豐厚的回報:當我們試圖將CNN偏向物體的更多物理特性時,我們突然達到了接近人類的噪聲穩健性。

我們繼續期待在2019年,在這一領域上會出現更多令人興奮的結果,獲得真正了解了真實世界中,物理和因果性質的卷積神經網絡。

本文轉自公眾號 新智元,原文地址

Comments