背景

本文是關於產品經理如何將機器學習融入其產品的大量研究(參見下文其他文章)的一部分,由Brian Polidori和我自己在加州大學伯克利分校的MBA學習,在Vince Law的幫助下擔任我們的指導老師。

該研究旨在了解產品經理如何設計,規劃和構建支持機器學習(ML)的產品。為了達到這種理解,我們採訪了各個技術公司的15位產品開發專家。在代表的15家公司中,14家公司的市值超過10億美元,11家公開上市,6家是B2C,9家是B2B。

產品經理指導ML系列:

如何管理機器學習模型

產品經理需要在構建支持機器學習(ML)的產品時進行權衡和考慮。不同的產品用例需要不同的ML模型。因此,學習如何管理ML模型的核心原則是關鍵的產品經理技能集。

平衡精確度與召回率

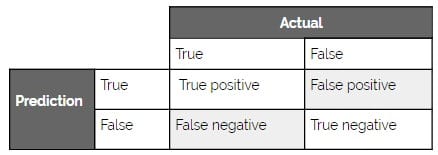

每個ML模型在某些時候都是錯誤的。因此,在構建支持ML的產品時,您需要考慮針對特定用例的誤報和漏報之間的正確平衡。

考慮這種平衡的另一種方法是精確與召回。精確度是檢索到的實例中真陽性的百分比,而召回是預測的陽性數量與真陽性總數的比值。這種關係稱為平衡的原因是精確度和召回率是相對負相關的(當其他條件相同時)。

雖然只有少數受訪者使用精確與召回術語提到了這種平衡,但很大一部分提到了在特定用例中找到平衡的重要性。Google相冊就是一個很好的例子。

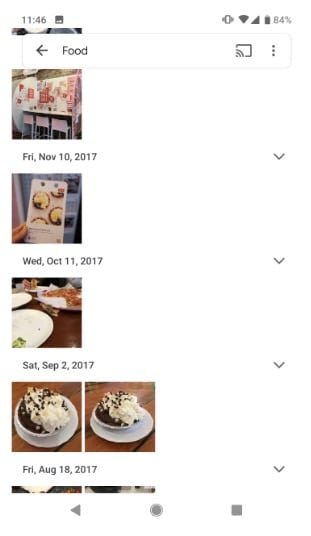

當用戶在Google照片中輸入搜索內容時,他們希望減少圖片數量,以便更容易找到他們想要的內容。因此,目標是降低噪音,因此,誤報的成本有限(因為替代方案正在查看所有照片)但是假陰性的成本很高(因為他們想要的東西可能不會浮出水面)。因此,Google Photos優先考慮高精度的高召回率。如圖所示,Google照片通常包含與搜索無關的圖像。

在精確與召回頻譜的另一端,我們的一位受訪者舉了一個例子,他們的公司(社交網路)專註於高精度。用例是確定如何對用戶個人訂閱源中顯示的內容進行排名和推薦。在進行一些實驗後,該公司發現如果推薦的內容與用戶不相關,則用戶攪動的可能性更高。

雖然這個結果看起來很明顯,但細微差別在於用戶使用移動設備時流失率最高。由於房地產有限,推薦的內容將佔據屏幕的很大一部分,因此,如果推薦的內容不是非常精確,用戶可能會流失。

根據我們的訪談和研究,我們創建了以下一般指導原則,作為如何考慮優先順序的起點。

關鍵點

何時優先考慮召回超過精確度:

- 異常檢測

- 合規

- 欺詐識別

何時優先考慮精確度而不是召回:

- 有限的空間(例如,移動設備,小部分)

- 建議

- 內容審核

準確度閾值

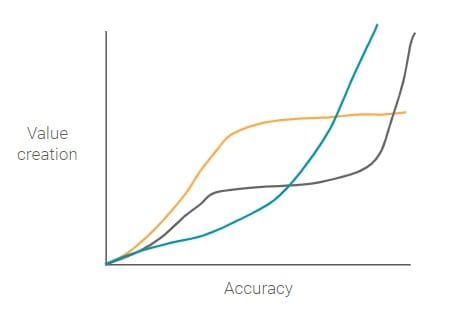

機器學習策略的核心部分取決於實現產品市場匹配所需的最低精度水平(模型正確預測的預測分數 – 參見召回和精確部分)。產品市場契合的良好代理是價值創造,其中創造的價值越多(對公司和用戶而言),產品市場越適合。因此,問題就變成了,不同準確度和價值創造之間的關係是什麼?

這個問題的答案取決於具體用例的細節。那麼,讓我們來看兩個例子。

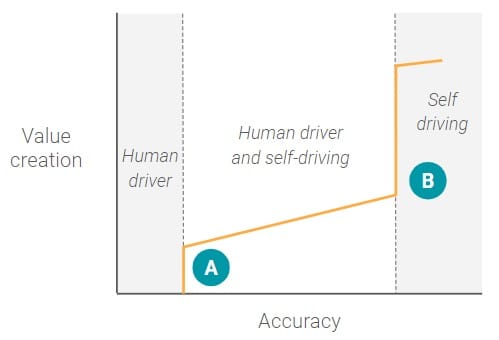

自動駕駛汽車

最初,當自動駕駛汽車ML模型具有非常低的準確度時,由於人類駕駛員根本不能依賴於系統,因此創建零值(或甚至可能是負值)。在某一點(A),有一個逐步的功能,其中ML模型具有足夠高的精確度,人類駕駛員可以在一些高度受限的環境中開始依賴系統,例如駕駛更均勻的高速公路。一旦達到此準確度級別,就會為該特定用例創建重要的價值(或產品市場適合度)。

然而,在A點之後,系統達到一個輕微的平台,其中精度水平的增加不對應於價值創造的相應增加,因為人類駕駛員仍然需要在一部分時間內參與。例如,汽車可能能夠在一段時間內停放自己,但無法處理高密度的城市街道,或者確切地知道街道一側的哪個地方讓您失望。從本質上講,ML模型還沒有達到下一個用例的最低精度閾值 – 完全自驅動能力。

一旦ML模型達到完全自動駕駛的最低精度閾值,就會有一種範例轉變為一種全新的用例,根本不涉及人類駕駛員。此時,產品團隊可以開始考慮從根本上改變新用例的產品,例如添加娛樂控制台或創建車隊。

Google相冊搜索

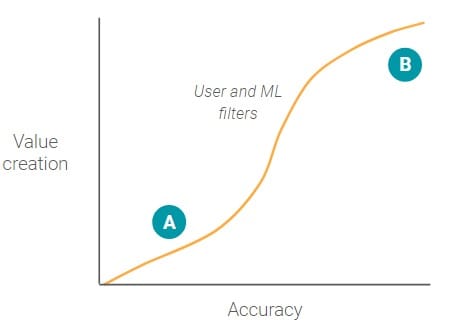

與自動駕駛準確度值創建圖形相比,Google照片圖像搜索沒有大的逐步功能。

當用戶搜索特定照片時,用戶鍵入單詞以創建過濾器並減少需要查看的照片的總數。即使精度很低,即A點,ML模型仍然可以通過減少用戶需要查看的照片總數來創造價值(假設ML模型具有較低的假陰性)。

隨著準確性不斷提高,隨著越來越多的無關照片被過濾掉,價值創造的速度也在不斷增加。在B點周圍的某個點,隨著準確性的不斷提高,價值創造的邊際收益遞減。這是因為過濾器已經消除了大多數其他照片,用戶可以快速輕鬆地查看所有照片結果,而無需滾動。

每個用例都將具有不同的準確度值創建圖。因此,您應仔細考慮特定用例的特徵,以確定1)是否存在關鍵準確度閾值,以及2)在這些準確度閾值之上需要哪些產品更改。

關於準確度閾值的關鍵問題

- 我的用例需要的最低準確度閾值是多少?

- 機器學習是用來增加手動過程嗎?

- 隨著人為參與的百分比降低,產品的功能要求如何變化?

- 在什麼時候你能夠完全從過程中移除人類?

- 如果精度達到一定水平,整個用例會發生變化嗎?

- 價值創造是否以零為界?或者,換句話說,是否可以創建的最大值減少到零,例如將欺詐減少到零?

探索與剝削

一些機器學習問題的主要挑戰之一是探索和開發之間的平衡。這個問題通常用稱為多臂強盜的賭場場景來說明。想像一下賭徒在一排「單臂強盜」老虎機。賭徒可以選擇測試多台機器以尋找具有最高支付(探索)的機器。或者賭徒可以選擇一台機器並嘗試建立一個最佳策略來贏得該機器(利用)。

最大化方面的定義(通常是點擊率等指標):

- 探索 - 在某種程度上隨機測試各種選項以試圖找到全局最大值。

- 利用 - 優化當地最大的現有問題空間。

對於支持ML的推薦產品,這種權衡是常見的。例如,Nordstroms的購物應用程序的屏幕空間有限,無法向用戶推廣產品。如果它向用戶顯示用戶從未查看過的新產品或品牌,Nordstrom正在探索該用戶是否有更高的全局最大值。這將為Nordstrom提供有關用戶之前未知偏好的更多信息(並且可能發現漏報),但是有太多誤報可能會對用戶體驗產生負面影響。

另一方面,Nordstrom以純粹的剝削方式向用戶展示他們看過或以前購買的產品和品牌。這種方法可以幫助Nordstroms僅根據用戶已知的內容進行優化(真正的積極因素)。

這不是解決的機器學習問題; 我們採訪過的許多公司都在不斷優化和調整模型,以找到合適的平衡點。最可能的解決方案是使用探索和開發技術的ML模型。

關鍵點

- 如果您有假陰性,探索是學習的最佳方式,但過度探索可能會導致許多誤報。

- 剝削是一種安全的方法,但它是限制性的,並且可能導致花費時間尋求不太理想的局部最大值。

本文轉自medium,原文地址

Comments