人工智能正在接管我们的生活 – 而且,似乎是我们的音乐制作。让我们插入黑客帝国,深入了解……

顾名思义,机器学习是AI的一种形式,计算机算法随时间分析和存储数据,然后使用这些数据做出决策并预测未来的结果。深度学习是下一步的演变:算法可以自动使用类似于人类大脑的“神经网络”,而不需要人类“监督”。简而言之,计算机代码行现在可以在某种程度上编程为自己学习,然后使用这些学习在远远超过人类能力的范围内执行复杂的操作。

被认为是过去几年中软件开发的最大进步,这项技术得益于计算能力和数据存储的革命性进步,现在已经成为日常生活中不可或缺的一部分,就像Siri或Alexa智能存储一样用于预测未来行动的数据。曾经想知道为什么Facebook的“你可能会认识的人”以及社交媒体上那些讨厌的建议广告总是如此准确?怪异的,对吧?在我们甚至提到人脸识别软件,垃圾邮件过滤,图像分类,欺诈检测之前……

是的,机器学习算法无处不在,音乐领域也不例外。对于我们在2019年的日常音乐听众来说,流媒体服务的算法驱动这些建议列表,帮助您搜索您从未正常发现的新歌曲和艺术家。去年,谷歌的Magenta研究部门开发了开源的NSynth Super,这是一种由NSynth算法驱动的合成器,旨在通过学习现有声音质量来创造全新的声音。

与此同时,自从Brian Eno的Koan驱动的Generative Music 1于1990年在软盘上发布以来,计算机辅助合成一直存在.Amper Music将这一概念带入了21世纪:它是一项使用深度学习自动组成计算机的服务 – 根据用户对“风格”或“情绪”的选择,为一段媒体生成音乐。内容创作者Taryn Southern以Amper Music的人工智能为基础,创作了一个完整的曲目,并且自此以后在YouTube上积累了近200万个剧本。

此外,这项技术正在被用来为音乐制作人和表演者提供帮助。Audionamix的Xtrax Stems 2使用基于云的机器学习辅助将完全混合的立体声轨道解构为三个组成子词干(声乐,鼓和音乐),然后可用于现场混音和DJ混搭。

无论你认为这些机器是否会接管我们的工作室,很明显人工智能技术仍然存在,我们正在见证音乐科技革命的开始。

机器人有音乐梦吗?

软件制造商iZotope在新版Ozone,Neutron和Nectar上使用了机器学习技术。它的首席技术官Jonathan Bailey让我们感到……

这些天,“机器学习”和“深度学习”这两个术语被广泛使用。他们究竟是什么意思,用外行人的话来说?

“机器学习是指更广泛的AI领域内的特定技术,它允许系统在大量数据中查找模式,或者根据以前看不见的数据做出决策。一个常见的例子是面部识别技术。手机上的软件显然从未见过您的照片 – 因为它们在您拍摄之前不存在 – 但它可以识别(’分类’)面孔和组(’群集’)它们。

“机器学习技术已经存在了几十年,主要集中在神经网络的使用上。神经网络是连接的统计模型,其灵感来自大脑中的神经元作为连接节点系统的方式。

“在过去十年中,两种力量相结合,允许机器学习技术的使用取得突破:数字数据的爆炸式增长,以及计算资源的廉价可用性(由于亚马逊网络服务等云计算解决方案)。这就是深度学习的用武之地。深度学习是指使用高度复杂的神经网络模型,这些模型使用多层节点,以复杂的配置连接,需要强大的计算机来训练大型数据集并进行操作。

摄影应该杀死绘画。它没有。我相信我们发明新想法的能力。

机器/深度学习如何帮助改进音乐家和音频专业人员的软件工具?

“过去几年,iZotope在这些技术上投入了大量资金。来自Neutron的一个例子,我们的智能通道条,使用深度学习来识别(’分类’)音乐会话中任何给定音轨中的音频表示哪种乐器,并基于该分类,以及我们在其中分析的一些额外的声学特性音频,我们建议应用哪种动态,均衡器和/或激励器设置来为您的混音准备音轨。

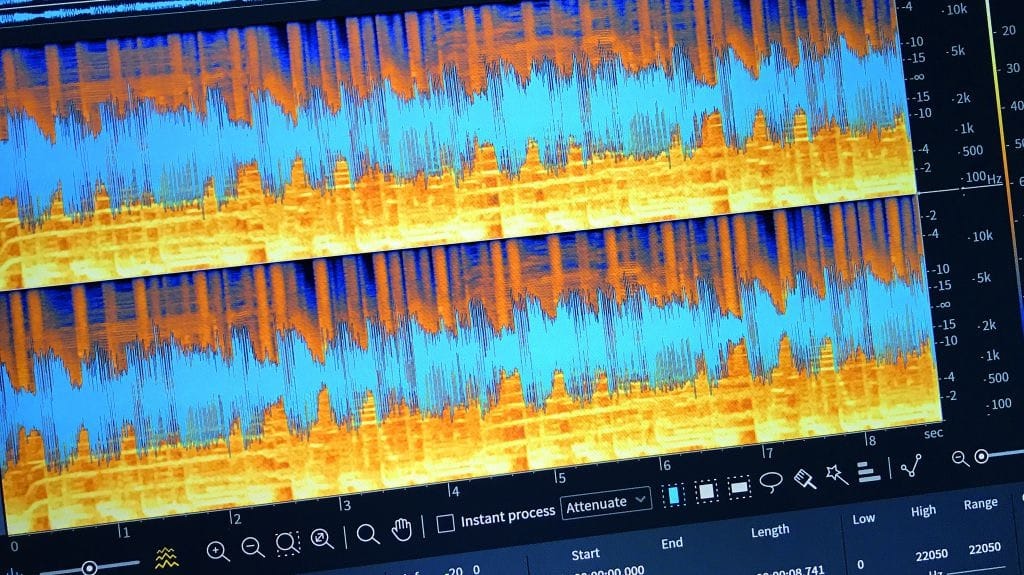

“我们现在正在使用深度学习,不仅要分析音频内容,还要处理它。在我们最近发布的RX 7中,音乐重新平衡功能使用深度学习将音乐混合物“混合”成单个词干,可以重新平衡或单独处理。我们正在探索将来如何使用深度学习来合成内容。“

有什么大的利弊?

“深度学习解决了我们过去难以解决的一些问题。例如,我们的许多客户要求我们采用一种方法来消除记录中的领夹式麦克风沙沙声,即使使用我们强大的光谱分析和处理技术也难以解决。

“对于有兴趣开发此功能的公司来说,使用深度学习技术变得越来越容易,但它仍然不那么容易。实施深度学习解决方案的主要挑战之一是获得良好的培训数据。对于传统上专注于算法开发的公司而言,这是一种新的领域。用于创建神经网络的软件是免费提供的,商品技术(Google TensorFlow是一个常见的例子)。正如我所说,对于一定规模的公司来说,获得大量计算能力是合理的。数据已成为一个巨大的瓶颈,并提出了一个有趣的问题。谷歌提供他们的软件,并为他们的云计算服务收取便士,但他们密切保护他们的数据。

“那就是说,深度学习不是灵丹妙药。我们仍然非常依赖来自数字信号处理规范的知识。学习如何有效地使用和训练深度神经网络变得越来越容易,但是尖端的研究仍然由高技能的科学家(通常是博士)完成。神经网络可能很难调试,有时它们会起到一种“黑匣子”的作用 – 你并不完全知道内部发生了什么。它们也是计算和资源密集型的,因此使它们在某些实时应用程序(如合成器或音频插件)中工作非常具有挑战性。

“深度学习是一个令人兴奋的故事,但最终,我们希望客户得到的结果不是魔法,而是她如何到达那里。”

音乐家如何在保留创造力的同时利用这项技术?

“有几个不同的研究营地。一个来自音乐学世界,专注于算法音乐作品。在这个领域,您拥有Amper Music,他们的产品可以为您的内容创建生成音乐示例,例如您的YouTube视频或广告。其他人专注于自动伴奏等应用。因此,一些团体正试图自动化创造力,而其他团体则试图加强创造力。

“这是一个非常微妙的平衡,但iZotope坚定地在增强创造力的阵营。我非常钦佩Google Magenta这样的研究团队,他们的目的是利用机器学习创造艺术 – 但这不是iZotope的理念或策略。我们希望使用深度学习来帮助您创作艺术。我们目前更专注于技术应用,但我确实看到我们进入更具创意的领域,只要我们坚持我们的创意目标。我们不是要取代人类的创造力。“

那么软件最终会为我们编写和混合我们的音乐吗?

“在某些情况下,它已经是。如果你是一个伟大的创作型歌手,但你从未在生活中开辟过DAW,深度学习将能够帮助你获得一个听起来很棒的录音,而无需了解压缩机是什么。如果您整天在DAW工作,它将了解您喜欢和不喜欢的效果,完成工作所需的视觉和听觉信息,并让您专注于音乐本身。

“摄影应该会扼杀绘画。它没有。我相信我们发明新想法的能力。”

本文转自musicradar,原文地址

Comments